Submitted:

23 December 2025

Posted:

24 December 2025

You are already at the latest version

Abstract

Keywords:

1. Introduction

- On our Bengali News (BANS) dataset, this is the first comprehensive study evaluating LLMs specifically for summarization tasks in the Bengali language within the newspaper domain.

- We propose the first reference-free, LLMs-as-Judges evaluation framework for Bangla News summarization that eliminates dependence on noisy BANS summaries and provides a scalable, reproducible, and human-aligned evaluation method. Also, We publicly release all prompts, evaluation rubrics, and LLM-judge protocol.

- We conduct the largest zero-shot performance benchmark of six state-of-the-art LLMs on the full 19,096-article BANS dataset. No previous work evaluates summarization at this scale in Bangla. We demonstrated that zero-shot LLMs can be rival fine-tuned models, achieving high-quality summaries even without task-specific training.

- Empirical results show that modern LLMs frequently outperform human-written summaries under reference-free evaluation, establishing zero-shot LLMs as a strong baseline for low-resource summarization.

- We provide the first systematic comparative analysis of summary length, model behavior, and linguistic quality across multiple LLMs in Bengali.

2. Literature Review

3. Methodology

3.1. Experimental Dataset

3.2. Model Selection and Configuration

- GPT-4: A powerful language model in the OPENAI GPT series excels in multistep reasoning, delivering accurate output in summarizations, text generation, and question answers, with a notable strength in tasks that require factual consistency.

- Llama-3.1-8B: This compact model from Meta has 8 billion parameters, 40 attention heads, a vocabulary of 128,000 tokens, and supports 8,192-token context windows. It offers competitive summarization quality through effective alignment with task instructions.

- Mixtral-8x22B-Instruct-v0.1: Mistral AI uses eight specialized components with 22 billion parameters. Mixtral combines a mixture-of-experts (MoE) design with large instruction-tuned capacity, activating only a subset of experts per input.

- Gemma-2-27B: Gemma-2-27B is a 27 billion multilingual transformer tailored for instruction following and content summarization.

- DeepSeek-R1-Distill-Llama-70B: DeepSeek-R1-Distill-Llama-70B is a large-scale distilled variant of the Llama-70B model, optimized for efficiency without sacrificing performance. The model delivers factually consistent and fluent outputs in multilingual settings.

- Qwen3-30B-A3B: Qwen3-30B-A3B is a high-capacity 30 billion-parameter multilingual model with strong optimization for Asian languages. Its scale and fine-grained instruction tuning allow it to generate precise summaries with strong semantic relevance.

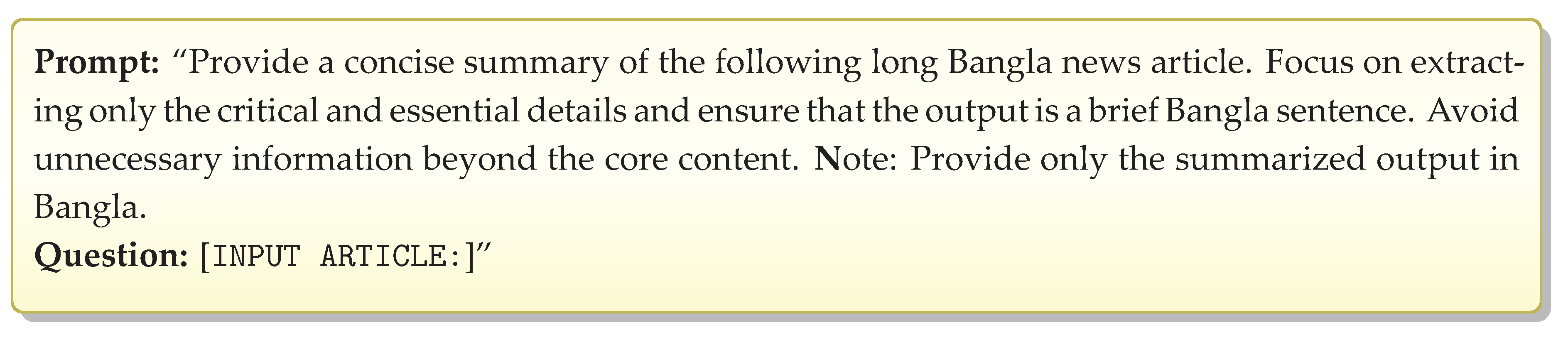

3.3. Prompt Design and Evaluation

3.4. Traditional Metric Assessment

3.5. LLMs-as-a-Judge Evaluation Framework

3.5.1. Judge Selection and Calibration

3.5.2. Evaluation Criteria

- Faithfulness (Factual Consistency): Measures the alignment between summary content and facts from the source article. The summary represents the actual or main text whether it is trustworthy or misleading information [24].

- Coherence (Readability): Coherence assesses logical flow, grammatical correctness, and overall clarity. It contains claims directly supported by the source document[25].

- Relevance (Informativeness): Relevance evaluates the inclusion of key information and exclusion of irrelevant details. The summary should condense the source by including only its essential information [25].

3.5.3. Evaluation Protocol

4. Results and Analysis

4.1. Comparative Analysis with Traditional Metrics

4.2. LLMs-as-a-Judge Performance Assessment

4.3. Analysis of Summary Quality

| Sample Text + summary 1 | |

|---|---|

| Article | কে জিতবে ২০১৪ সালের ফিফা ব্যালন ডিঅর? সংক্ষিপ্ত তালিকায় আছেন গত বছরের বিজয়ী ক্রিস্তিয়ানো রোনালদো এবং রানার্সআপ লিওনেল মেসি। এই তালিকায় প্রথমবারের মতো জায়গা পাওয়া মানুয়েল নয়ারেরও ভালো সম্ভাবনা আছে। |

| Existing Summary | রোনালদো, মেসি না নয়ার? |

| GPT-4 Summary | ২০১৪ সালের ফিফা ব্যালন ডি’অরের শীর্ষ তালিকায় আছেন রোনালদো, মেসি ও নয়ার। |

| Deepseek-R1 Summary | ২০১৪ সালের ফিফা ব্যালন ডি’অরের জন্য ক্রিস্তিয়ানো রোনালদো, লিওনেল মেসি ও মানুয়েল নয়ারের ভাল সম্ভাবনা ছিল। |

| Qwen3-30B-A3 Summary | ২০১৪ সালের ফিফা ব্যালন ডি’অরের সংক্ষিপ্ত তালিকায় রয়েছেন ক্রিস্তিয়ানো রোনালদো, লিওনেল মেসি ও মানুয়েল নয়ার। |

| Sample Text + summary 2 | |

| Article | মাঝারি থেকে দূরপাল্লার ক্ষেপণাস্ত্রের সফল পরীক্ষার কথা জানানোর পর উত্তর কোরিয়া ফের জাতিসংঘ ও যুক্তরাষ্ট্রের হুঁশিয়ারি উপেক্ষা করে যে কোনও সময়, যে কোনও স্থান থেকে এ ধরনের পরীক্ষা চালিয়ে যাওয়ার হুমকি দিয়েছে। |

| Existing Summary | যেকোনও সময় ফের ক্ষেপণাস্ত্র পরীক্ষার হুমকি উত্তর কোরিয়ার |

| GPT-4 Summary | উত্তর কোরিয়া সফল ক্ষেপণাস্ত্র পরীক্ষা শেষে আরও পরীক্ষার হুমকি দিয়েছে। |

| Deepseek-R1 Summary | উত্তর কোরিয়া মাঝারি থেকে দূরপাল্লার ক্ষেপণাস্ত্র পরীক্ষা চালিয়ে যাওয়ার হুমকি দিয়েছে। |

| Qwen3-30B-A3 Summary | উত্তর কোরিয়া মাঝারি ও দূরপাল্লার ক্ষেপণাস্ত্র পরীক্ষার পর জাতিসংঘ ও যুক্তরাষ্ট্রের সতর্কতা উপেক্ষা করে আরও পরীক্ষার হুমকি দিয়েছে। |

| Model | Word Count |

|---|---|

| DeepSeek-R1 | 12 |

| Gemma-2-27B | 15 |

| GPT-4 | 10 |

| Llama-3.1-8B | 11 |

| Mixtral-8x22B | 13 |

| Qwen3-30B-A3B | 17 |

5. Conclusions

Acknowledgments

References

- Miazee, A.A.; Roy, T.; Islam, M.R.; Safat, Y. Abstractive Text Summarization for Bangla Language Using NLP and Machine Learning Approaches. In Proceedings of the 2025 International Conference on Electrical, Computer and Communication Engineering (ECCE), 2025; IEEE; pp. 1–4. [Google Scholar]

- Hayat, S.A.I.; Das, A.; Hoque, M.M. Abstractive bengali text summarization using transformer-based learning. In Proceedings of the 2023 6th International Conference on Electrical Information and Communication Technology (EICT), 2023; IEEE; pp. 1–6. [Google Scholar]

- Abrar, A.; Oeshy, N.T.; Kabir, M.; Ananiadou, S. Religious bias landscape in language and text-to-image models: Analysis, detection, and debiasing strategies. AI & SOCIETY 2025, 1–27. [Google Scholar]

- Sultana, F.; Fuad, M.T.H.; Fahim, M.; Rahman, R.R.; Hossain, M.; Amin, M.A.; Rahman, A.M.; Ali, A.A. How Good are LM and LLMs in Bangla Newspaper Article Summarization? In Proceedings of the International Conference on Pattern Recognition, 2024; Springer; pp. 72–86. [Google Scholar]

- Abrar, A.; Oeshy, N.T.; Maheru, P.; Tabassum, F.; Chowdhury, T.M. Faithful Summarization of Consumer Health Queries: A Cross-Lingual Framework with LLMs. arXiv preprint 2025, arXiv:2511.10768. [Google Scholar]

- Bhattacharjee, P.; Mallick, A.; Saiful Islam, M. Bengali abstractive news summarization (BANS): a neural attention approach. In Proceedings of the Proceedings of International Conference on Trends in Computational and Cognitive Engineering: Proceedings of TCCE 2020, 2020; Springer; pp. 41–51. [Google Scholar]

- Lin, C.Y. Rouge: A package for automatic evaluation of summaries. In Proceedings of the Text summarization branches out, 2004; pp. 74–81. [Google Scholar]

- Zhang, T.; Kishore, V.; Wu, F.; Weinberger, K.Q.; Artzi, Y. Bertscore: Evaluating text generation with bert. arXiv preprint 2019, arXiv:1904.09675. [Google Scholar]

- Achiam, J.; Adler, S.; Agarwal, S.; Ahmad, L.; Akkaya, I.; Aleman, F.L.; Almeida, D.; Altenschmidt, J.; Altman, S.; Anadkat, S.; et al. Gpt-4 technical report. arXiv preprint 2023, arXiv:2303.08774. [Google Scholar]

- Dubey, A.; Jauhri, A.; Pandey, A.; Kadian, A.; Al-Dahle, A.; Letman, A.; Mathur, A.; Schelten, A.; Yang, A.; Fan, A.; et al. The llama 3 herd of models. arXiv e-prints 2024, arXiv–2407. [Google Scholar]

- Jiang, A.Q.; Sablayrolles, A.; Roux, A.; Mensch, A.; Savary, B.; Bamford, C.; Chaplot, D.S.; Casas, D.d.l.; Hanna, E.B.; Bressand, F.; et al. Mixtral of experts. arXiv preprint 2024. arXiv:2401.04088.

- Team, G.; Riviere, M.; Pathak, S.; Sessa, P.G.; Hardin, C.; Bhupatiraju, S.; Hussenot, L.; Mesnard, T.; Shahriari, B.; Ramé, A.; et al. Gemma 2: Improving open language models at a practical size. arXiv preprint 2024. arXiv:2408.00118.

- Guo, D.; Yang, D.; Zhang, H.; Song, J.; Zhang, R.; Xu, R.; Zhu, Q.; Ma, S.; Wang, P.; Bi, X.; et al. Deepseek-r1: Incentivizing reasoning capability in llms via reinforcement learning. arXiv preprint arXiv:2501.12948.

- Xu, J.; Guo, Z.; Hu, H.; Chu, Y.; Wang, X.; He, J.; Wang, Y.; Shi, X.; He, T.; Zhu, X.; et al. Qwen3-Omni Technical Report. arXiv preprint arXiv:2509.17765.

- Abrar, A.; Tabassum, F.; Ahmed, S. Performance Evaluation of Large Language Models in Bangla Consumer Health Query Summarization. In Proceedings of the 2024 27th International Conference on Computer and Information Technology (ICCIT), 2024; IEEE; pp. 2748–2753. [Google Scholar]

- Rony, M.A.T.; Islam, M.S. Evaluating Large Language Models for Summarizing Bangla Texts. In Proceedings of the Proceedings of the Eighth Widening NLP Workshop (WiNLP 2024) Phase II, 2024. [Google Scholar]

- Sultana, F.; Fuad, M.T.H.; Fahim, M.; Rahman, R.R.; Hossain, M.; Amin, M.A.; Rahman, A.M.; Ali, A.A. How Good are LM and LLMs in Bangla Newspaper Article Summarization? In Proceedings of the International Conference on Pattern Recognition, 2024; Springer; pp. 72–86. [Google Scholar]

- Tanjila, N.A.; Poushi, A.S.; Farhan, S.A.; Kamal, A.R.M.; Hossain, M.A.; Ashmafee, M.H. Bengali ChartSumm: A Benchmark Dataset and Study on Feasibility of Large Language Models on Bengali Chart to Text Summarization. In Proceedings of the Proceedings of the First Workshop on Challenges in Processing South Asian Languages (CHiPSAL 2025), 2025; pp. 35–45. [Google Scholar]

- Kabir, M.; Islam, M.S.; Laskar, M.T.R.; Nayeem, M.T.; Bari, M.S.; Hoque, E. Benllmeval: A comprehensive evaluation into the potentials and pitfalls of large language models on bengali nlp. arXiv 2023, arXiv:2309.13173. [Google Scholar]

- Talukder, M.A.I.; Abujar, S.; Masum, A.K.M.; Faisal, F.; Hossain, S.A. Bengali abstractive text summarization using sequence to sequence RNNs. In Proceedings of the 2019 10th International Conference on Computing, Communication and Networking Technologies (ICCCNT), 2019; IEEE; pp. 1–5. [Google Scholar]

- Fabbri, A.R.; Kryściński, W.; McCann, B.; Xiong, C.; Socher, R.; Radev, D. Summeval: Re-evaluating summarization evaluation. Transactions of the Association for Computational Linguistics 2021, 9, 391–409. [Google Scholar] [CrossRef]

- Ahmed, T.; Devanbu, P. Few-shot training llms for project-specific code-summarization. In Proceedings of the Proceedings of the 37th IEEE/ACM international conference on automated software engineering, 2022; pp. 1–5. [Google Scholar]

- bdnews24.com. bdnews24.com. https://bangla.bdnews24.com/, 2025. Accessed: Sep. 30, 2025.

- Delpisheh, N. Improving faithfulness in abstractive text summarization with EDUs using BART. Master’s thesis, University of Lethbridge (Canada), 2023. [Google Scholar]

- Fabbri, A.R.; Kryściński, W.; McCann, B.; Xiong, C.; Socher, R.; Radev, D. Summeval: Re-evaluating summarization evaluation. Transactions of the Association for Computational Linguistics 2021, 9, 391–409. [Google Scholar] [CrossRef]

| Total Articles | 19,096 |

|---|---|

| Total Summaries | 19,096 |

| Summary per Article | 1 |

| Article (Original Text) | Summary (Human-Written) |

|---|---|

| ব্রিটিশ অ্যাকাডেমি অফ ফিল্মস অ্যান্ড টেলিভিশন আর্টস বা বাফটা অ্যাওয়ার্ডের আসর বসেছে ফেব্রুয়ারিতে। মনোনয়নের দিক থেকে শীর্ষে রয়েছে আত্মজীবনীমূলক সিনেমা ’দ্য থিওরি অফ এভরিথিং’ এবং কমেডি সিনেমা ’দ্য গ্র্যান্ড বুদাপেস্ট হোটেল’। সিনেমা দুটি চারটি প্রধান ক্যাটাগরিতেই মনোনয়ন পেয়েছে। | বাফটা মনোনয়ন এগিয়ে দ্য গ্র্যান্ড বুদাপেস্ট হোটেল। |

| মাইকেল ক্লার্ককে বিশ্বকাপের চূড়ান্ত দল রাখলেও খেলার উপযোগী হয়ে ওঠার জন্য সময়সীমা বেধে দিয়েছেন অস্ট্রেলিয়ার নির্বাচকরা। পুরোপুরি সুস্থ হয়ে খেলার উপযোগী হতে বিশ্বকাপ শুরু হওয়ার আগেই তাদের দ্বিতীয় ম্যাচ পর্যন্ত সময় পেয়েছেন স্বাগতিকদের অধিনায়ক। | বিশ্বকাপের জন্য ক্লার্ককে সময় দিলেন অস্ট্রেলিয়ার নির্বাচকরা |

| কে জিতবে ২০১৪ সালের ফিফা ব্যালন ডি’অর? সংক্ষিপ্ত তালিকায় আছেন গত বছরের বিজয়ী রোনালদো, রানার্সআপ লিওনেল মেসি এবং মানুয়েল নয়্যার। | রোনালদো, মেসি না নয়ার? |

| মাঝারি থেকে দূরপাল্লার ক্ষেপণাস্ত্রের সফল পরীক্ষার কথা জানানোর পর উত্তর কোরিয়া ফের জাতিসংঘ ও যুক্তরাষ্ট্রের হুঁশিয়ারি উপেক্ষা করে যেকোনও সময়, যেকোনও স্থান থেকে এ ধরনের পরীক্ষা চালিয়ে যাওয়ার হুমকি দিয়েছে। | যেকোনও সময় ফের ক্ষেপণাস্ত্র পরীক্ষার হুমকি উত্তর কোরিয়ার। |

| Model Name | R1 | R2 | RL | BERTScore |

|---|---|---|---|---|

| DeepSeek-R1 | 47.79 | 12.42 | 45.67 | 87.58 |

| Gemma-2-27B | 45.40 | 13.32 | 42.33 | 83.54 |

| GPT-4 | 52.83 | 17.33 | 49.65 | 92.48 |

| Llama-3.1-8B | 49.71 | 16.14 | 47.25 | 89.22 |

| Mixtral-8x22B | 50.91 | 15.31 | 48.79 | 90.87 |

| Qwen3-30B-A3B | 44.28 | 14.49 | 42.50 | 82.11 |

| Model Name | Faithfulness | Coherence | Relevance | Overall score |

|---|---|---|---|---|

| DeepSeek-R1 | 4.60 | 4.74 | 4.66 | 4.75 |

| Gemma-2-27B | 4.40 | 4.70 | 4.61 | 4.64 |

| GPT-4 | 4.80 | 4.85 | 4.82 | 4.89 |

| Llama-3.1-8B | 4.70 | 4.80 | 4.76 | 4.82 |

| Mixtral-8x22B | 4.55 | 4.78 | 4.73 | 4.77 |

| Qwen3-30B-A3B | 4.30 | 4.65 | 4.61 | 4.59 |

Disclaimer/Publisher’s Note: The statements, opinions and data contained in all publications are solely those of the individual author(s) and contributor(s) and not of MDPI and/or the editor(s). MDPI and/or the editor(s) disclaim responsibility for any injury to people or property resulting from any ideas, methods, instructions or products referred to in the content. |

© 2025 by the authors. Licensee MDPI, Basel, Switzerland. This article is an open access article distributed under the terms and conditions of the Creative Commons Attribution (CC BY) license (http://creativecommons.org/licenses/by/4.0/).